Resumo: O que são proxies ISP? São IPs residenciais estáticos alojados num centro de dados. Os sistemas de deteção identificam um ASN residencial; obtém-se o débito de um centro de dados. São a escolha certa quando as sessões, a vinculação de contas e os preços previsíveis por IP são mais importantes do que o alcance geográfico bruto.

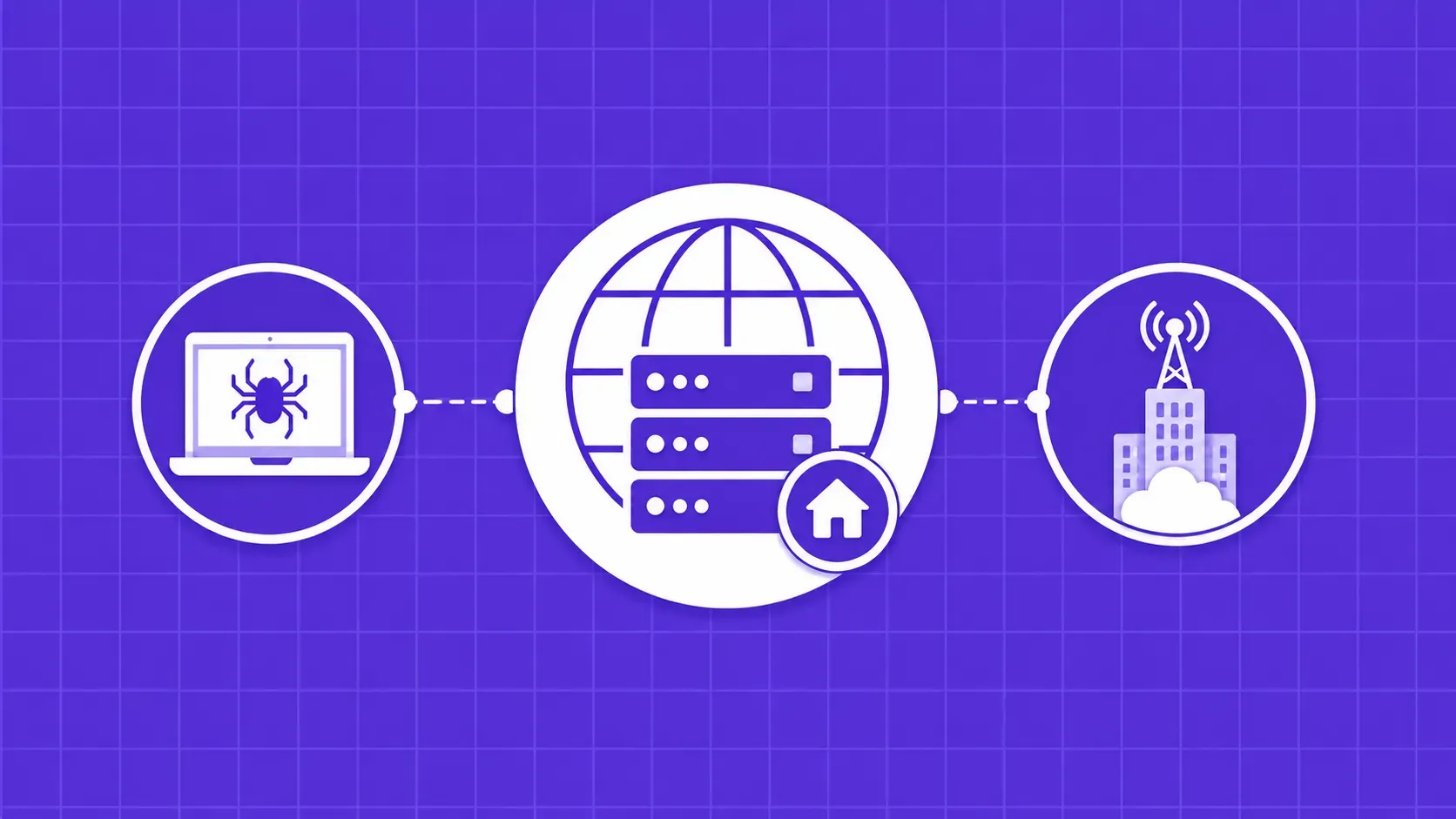

Então, o que são proxies ISP e por que razão os profissionais estão a transferir cargas de trabalho de conjuntos residenciais rotativos para um IP estático alojado num centro de dados? Em termos gerais, um proxy ISP é um servidor proxy que se encontra dentro de um centro de dados, mas expõe um endereço IP atribuído por um fornecedor de serviços de Internet real. Os sistemas de deteção veem tráfego proveniente de um ASN residencial, enquanto o seu código obtém a largura de banda e o perfil de latência da infraestrutura na nuvem.

O resto do mercado de proxies divide-se em duas categorias mais conhecidas: proxies de centro de dados (baratos e rápidos, mas fáceis de identificar porque muitos utilizadores partilham os mesmos IPs) e proxies residenciais (IPs fiáveis que são encaminhados através de ligações domésticas reais, mas mais lentos e cobrados por gigabyte). Os proxies ISP situam-se no meio. São por vezes chamados de proxies residenciais estáticos porque o IP pertence a um bloco de ISP real, mas permanece o mesmo em todas as solicitações.

Se está a criar pipelines de scraping, monitores de SEO, verificações de anúncios ou fluxos de trabalho sociais com várias contas, a resposta à pergunta «o que são proxies ISP e quando os utilizar» determina diretamente a taxa de bloqueio, o débito e a estabilidade da sessão.