Resumo: As páginas de produtos da Amazon estão repletas de dados valiosos (preços, classificações, comentários, ASINs), mas extraí-los de forma fiável requer mais do que uma simples solicitação HTTP. Este guia orienta-o na criação de um scraper em Python com as bibliotecas Requests e BeautifulSoup, abordando a paginação e as defesas contra bots, a exportação para CSV ou JSON e a integração dos resultados em fluxos de trabalho de LLM. Também irá aprender quando utilizar uma API de scraping em vez de criar a sua própria solução.

Se precisar de extrair dados de produtos da Amazon em qualquer escala significativa, já sabe que a plataforma não facilita a tarefa. A Amazon é o maior mercado de comércio eletrónico do mundo, gerando alegadamente mais de 500 mil milhões de dólares em receitas líquidas anuais de vendas. Isso torna o seu catálogo de produtos um dos conjuntos de dados mais valiosos (e mais fortemente protegidos) da web pública.

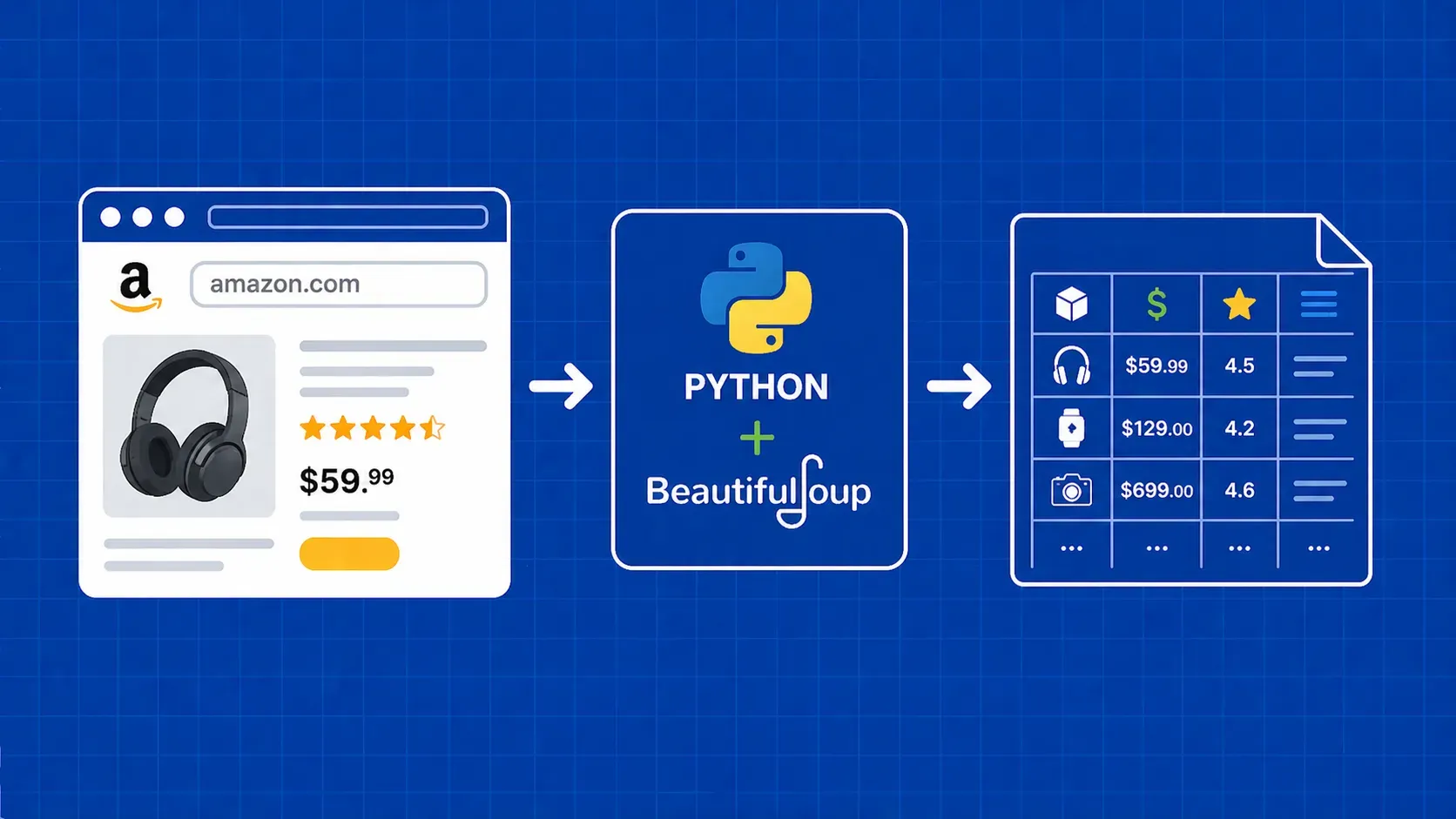

Extrair produtos da Amazon da Web significa extrair programaticamente informações estruturadas, como títulos, preços, classificações, imagens e ASINs, das páginas HTML da Amazon. Quer esteja a criar um painel de monitorização de preços, a realizar uma pesquisa de mercado competitiva ou a reunir dados de treino para um modelo de aprendizagem automática, o fluxo de trabalho começa com os mesmos princípios básicos: enviar um pedido HTTP, analisar a resposta e extrair os campos que lhe interessam.

O desafio é que a Amazon bloqueia ativamente o tráfego automatizado. CAPTCHAs, bloqueios de IP, HTML dinâmico e o AWS WAF são todos obstáculos entre si e os dados limpos. Este guia abrange todo o processo: configuração do ambiente, estrutura da página, um scraper Python funcional com BeautifulSoup, paginação, tratamento anti-bot, exportação de dados e até mesmo como canalizar os resultados extraídos para um LLM. Também iremos comparar o scraping DIY com alternativas de API e sem código, para que possa escolher a abordagem que melhor se adequa ao seu projeto.