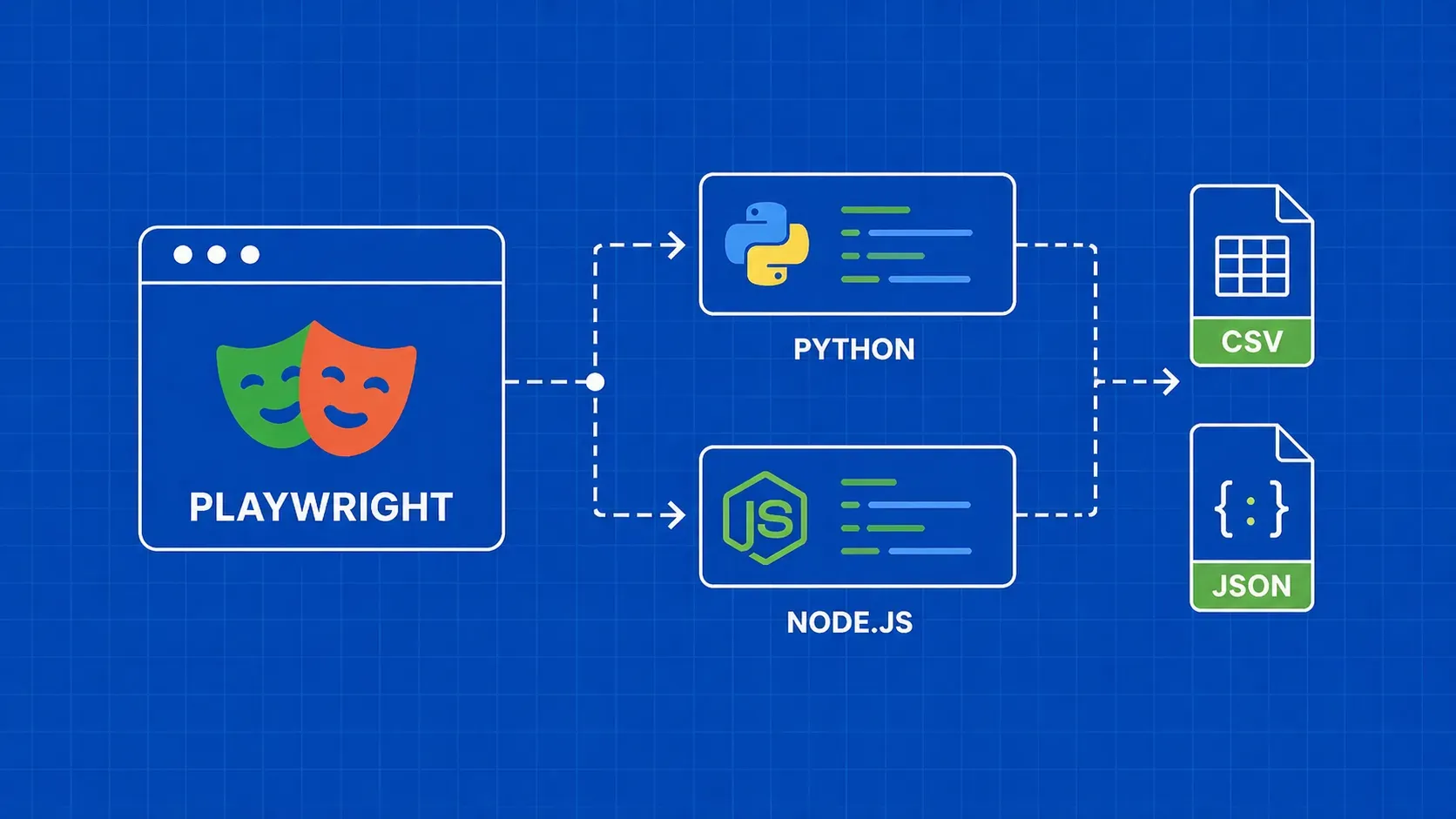

Resumo: O Playwright oferece automação completa do navegador para extrair dados de sites com uso intensivo de JavaScript, com suporte de primeira classe tanto para Python como para Node.js. Este guia orienta-o passo a passo pela instalação, extração de elementos, configuração de proxy, medidas anti-detecção, paginação, download de imagens e exportação de dados para CSV ou JSON, tudo acompanhado de exemplos de código lado a lado em ambas as linguagens.

Se já tentou extrair dados de uma aplicação moderna de página única com um cliente HTTP simples, já conhece o problema: o HTML que recebe é uma estrutura vazia, e os dados que procura estão dentro de JavaScript que nunca é executado. A extração de dados web com o Playwright resolve isto ao controlar um navegador real (Chromium, Firefox ou WebKit) programaticamente, permitindo que o seu script veja exatamente o que um visitante humano veria.

O Playwright é uma estrutura de automação de navegadores de código aberto mantida pela Microsoft. Ao contrário de ferramentas mais antigas, vem com espera automática integrada, interceção de rede e suporte para vários motores de navegador prontos a usar. Quer escreva em Python ou Node.js, a superfície da API é quase idêntica, pelo que pode escolher a linguagem que melhor se adequa à sua pilha.

Este guia abrange tudo o que precisa para passar de um terminal em branco para scripts de scraping com o Playwright prontos para produção: configuração, seletores, extração de texto e imagens, paginação, interceção de pedidos, configuração de proxy, técnicas de camuflagem, tratamento de erros e exportação de dados estruturados. Cada técnica inclui código tanto para Python como para Node.js.